“Tình Trạng Lạm Dụng AI” Và Liệu Chúng Ta Có Đang Đánh Mất Tư Duy Phản Biện Của Mình?

[ToMo] “Tình Trạng Lạm Dụng AI” Và Liệu Chúng Ta Có Đang Đánh Mất Tư Duy Phản Biện Của Mình?

Trong cuốn sách "Không Thể Thay Thế: Nghệ Thuật Nổi Bật Trong Thời Đại Trí Tuệ Nhân Tạo", Pascal Bornet giới thiệu khái niệm "tình trạng béo phì AI".

Thuật ngữ này ám chỉ sự phụ thuộc quá mức vào AI — cũng như việc tiêu thụ quá nhiều thức ăn nhanh có thể khiến chúng ta béo phì, thì việc lệ thuộc quá mức vào AI có thể khiến chúng ta "béo phì về tinh thần".

Ông cho rằng rủi ro chính của việc tiêu thụ quá mức là chúng ta có thể đánh mất khả năng tư duy phê phán nếu trở nên nghiện sự sáng tạo nhanh và những quyết định chóng vánh.

“Tư duy phản biện là nghệ thuật đưa ra các phán đoán rõ ràng, có lý dựa trên việc diễn giải, hiểu, áp dụng và tổng hợp bằng chứng thu thập từ quan sát, đọc hiểu và thực nghiệm.” (Burns, T., & Sinfield, S. 2016)

Tư duy phản biện đòi hỏi phải phân tích các bằng chứng từ nhiều nguồn khác nhau và đưa ra kết luận có lý. Khi sử dụng công cụ AI, chúng ta cần có kỹ năng tư duy phản biện để đánh giá đầu ra và quyết định liệu có nên đồng ý với nó hay không.

"Tình trạng béo phì AI" có thể khiến con người ưu tiên tốc độ và hiệu quả hơn là tư duy, dẫn đến việc ra quyết định mà không cân nhắc kỹ đầu ra. Như Bornet đã đặt câu hỏi trong cuốn sách của mình: Liệu chúng ta có đang chấp nhận những giải pháp "tạm ổn" thay vì nỗ lực hướng tới sự xuất sắc?

Mục đích của bài viết này là phản ánh về tầm quan trọng của tư duy phản biện. Nhưng trước tiên, chúng ta hãy điểm qua lịch sử của các mô hình ngôn ngữ lớn (LLMs), cho thấy rào cản ngôn ngữ đã dần được vượt qua như thế nào, đồng thời lý luận và tư duy phản biện cũng được cải thiện ra sao.

Lịch sử của các mô hình ngôn ngữ bắt đầu từ năm 1883 với khái niệm ngữ nghĩa do nhà ngôn ngữ học người Pháp Michel Bréal phát triển – ông là người sáng lập ngành ngữ nghĩa học hiện đại. Bréal nghiên cứu cách ngôn ngữ được tổ chức và cách các từ có liên hệ với nhau.

Xử lý ngôn ngữ tự nhiên (Natural Language Processing - NLP) trở nên phổ biến sau Thế chiến thứ II năm 1945, khi các cuộc đàm phán hòa bình làm nổi bật tầm quan trọng của việc dịch tự động giữa các ngôn ngữ.

Nghiên cứu về NLP bắt đầu với các dự án dịch máy như Thí nghiệm Georgetown-IBM (1954). Arthur Samuel của IBM đã tạo ra chương trình chơi Cờ Đam cho máy tính (trò chơi giúp các chương trình máy tính nhân tạo tiến hóa), và đến năm 1959, ông phát triển các thuật toán cho phép chương trình tự học – gọi đó “Công nghệ Máy học” (Machine learning)

Năm 1958, Frank Rosenblatt kết hợp học thuyết Hebbian với nghiên cứu của Samuel để tạo ra Mạng Nơ-ron nhân tạo đầu tiên (Artificial Neural Network - ANN), gọi là Mark 1 Perceptron.

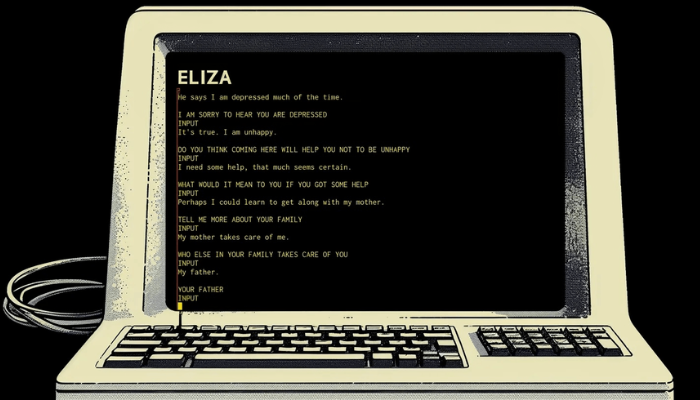

Đến năm 1966, chương trình ELIZA ra đời – đây là chương trình máy tính NLP đầu tiên có thể tiến hành hội thoại như con người. ELIZA có thể nhận diện đầu vào đơn giản từ người dùng và phản hồi dựa trên các kịch bản được lập trình sẵn. Dù đơn giản, ELIZA đã tạo ra ảo giác rằng máy tính "thấu hiểu" con người.

Bước sang những năm 1990, các phương pháp phân tích văn bản và sản sinh ngôn ngữ như N-Gram và Mạng Nơ-ron hồi tiếp (Recurrent Neural Networks - RNNs) trở nên phổ biến. Năm 2006, Google ra mắt Google Dịch – dịch văn bản và tài liệu qua nhiều ngôn ngữ.

Siri của Apple, ra đời năm 2011, là trợ lý ảo NLP đầu tiên thành công. Siri chuyển lời nói của người dùng thành khái niệm số hóa, rồi thực hiện hành động tương ứng. Tuy nhiên, Siri vẫn gặp khó khăn trong việc hiểu các giọng địa phương, phương ngữ và môi trường ồn ào.

Năm 2017, kiến trúc “Transformer” được giới thiệu bởi Google. Transformer sử dụng cơ chế “Tự chú ý” (self-attention) để nắm bắt mối liên hệ trong chuỗi dữ liệu đầu vào và cải thiện hiệu suất dịch máy.

Từ đó, hàng loạt mô hình tiền đào tạo ra đời như GPT (Generative Pre-trained Transformer) và BERT (Bidirectional Encoder Representations from Transformers).

Năm 2019, GPT-2 đánh dấu bước ngoặt khi có thể tạo ra các câu có nghĩa. Đến năm 2020, GPT-3 ra đời với số lượng tham số gấp hàng trăm lần so với GPT-2.

Năm 2022, OpenAI ra mắt ChatGPT – vượt trội hơn hẳn GPT-3 về khả năng giao tiếp, lập trình và viết bài.

Song song với GPT-3, Google cũng giới thiệu T5 (Text-to-Text Transfer Transformer) - Mô hình chuyển văn bản thành văn bản, nơi cả đầu vào và đầu ra đều ở dạng chuỗi ký tự.

GPT-4 đánh dấu một cột mốc mới trong sự phát triển của LLM. Nó là mô hình ngôn ngữ đa phương tiện (multimodal), kết hợp khả năng sáng tạo, xử lý hình ảnh và văn bản dài.

OpenAI cho biết GPT-4: “Đáng tin cậy hơn, sáng tạo hơn và xử lý hướng dẫn tinh tế hơn GPT-3.5.”

Mặc dù sở hữu những khả năng này, GPT-4 vẫn mắc những sai lầm ngớ ngẩn và đưa ra các tuyên bố sai lệch. Chẳng hạn, GPT-4 được cho là hiểu khá rõ về các thuật toán nhưng lại gặp khó khăn với số học hoặc ký hiệu toán học.

Theo M. M. Jahani Yekta, điều này là do dữ liệu huấn luyện không bao gồm logic chuyên ngành (quá trình tư duy dẫn đến lời giải), cũng như kiến trúc dự đoán từ tiếp theo (next-word prediction) vốn có hạn chế về tư duy phản biện.

Tầm quan trọng của kỹ năng phản biện

Trong thế giới AI, các mô hình ngôn ngữ được thiết kế để mô phỏng hành vi con người ngay cả khi thiếu ngữ cảnh. Ví dụ, khi yêu cầu ChatGPT tóm tắt bài nghiên cứu, nó sẽ thực hiện mà không biết người dùng là ai hay mục đích tóm tắt là gì.

GPT-4 không xét ngữ cảnh mà người hỏi đưa ra.

Vậy nên đầu tiên, ta phải xem xét xem ngữ cảnh mang ý nghĩa gì trong LLMs.

Cửa sổ ngữ cảnh trong LLMs là gì?

Hãy tưởng tượng bạn cần tóm tắt một cuốn sách nhưng chỉ đọc được vài trang tại một thời điểm. Đó chính là cách LLM hoạt động – chúng có giới hạn về lượng thông tin (tokens) mà chúng có thể xử lý cùng lúc, gọi là “cửa sổ ngữ cảnh”.

Kích thước cửa sổ ngữ cảnh ảnh hưởng trực tiếp đến chất lượng đầu ra. Nhưng cửa sổ càng lớn thì càng tốn tài nguyên tính toán.

Một cửa sổ ngữ cảnh có kích thước phù hợp giúp các mô hình ngôn ngữ lớn (LLMs) đưa ra các dự đoán chính xác hơn và tạo ra văn bản có chất lượng cao hơn. Kích thước này bị ảnh hưởng bởi một số yếu tố:

Thiết kế và mục tiêu của mô hình: Các mô hình được xây dựng để phân tích tài liệu, tạo nội dung hoặc trả lời câu hỏi thường cần cửa sổ ngữ cảnh lớn hơn để xử lý và ghi nhớ thông tin trong thời gian dài hơn.

Tài nguyên tính toán gia tăng: Cửa sổ ngữ cảnh lớn hơn yêu cầu nhiều bộ nhớ và khả năng xử lý hơn.

Dữ liệu đào tạo: Dữ liệu dùng để đào tạo cũng có thể ảnh hưởng đến cửa sổ ngữ cảnh. Các mô hình được đào tạo trên tập dữ liệu lớn và đa dạng thường cần cửa sổ ngữ cảnh rộng hơn.

Cân bằng hiệu suất: Mặc dù cửa sổ ngữ cảnh lớn có thể cải thiện khả năng hiểu và chất lượng đầu ra của mô hình, nhưng nó cũng đòi hỏi tài nguyên tính toán lớn hơn và có thể làm chậm tốc độ xử lý. Việc tìm ra điểm cân bằng giữa hai yếu tố này là rất quan trọng.

Cửa sổ ngữ cảnh là yếu tố then chốt trong việc đánh giá hiệu suất của một LLM. Nó giống như một thấu kính mà qua đó các mô hình ngôn ngữ nhìn và diễn giải thông tin. Kích thước và hiệu quả của thấu kính này ảnh hưởng trực tiếp đến khả năng hiểu và phản hồi ngôn ngữ một cách có ý nghĩa của mô hình.

Mặc dù các cửa sổ ngữ cảnh đã có nhiều cải tiến, chúng vẫn chưa thể bắt chước cách con người xử lý ngữ cảnh. Các mô hình LLM vẫn còn hơi nông về mặt ngữ nghĩa; chúng gặp khó khăn trong việc hiểu sắc thái văn hóa và cảm xúc, đồng thời có trí nhớ hạn chế — khi vượt quá cửa sổ ngữ cảnh, mô hình sẽ "quên" thông tin trước đó.

Andrew Ye và các cộng sự đã thảo luận những hạn chế này trong một nghiên cứu tình huống được trình bày tại hội thảo COLM 2024, và sẽ được nêu chi tiết trong phần tiếp theo.

Kết quả từ nghiên cứu tình huống "Các mô hình ngôn ngữ như công cụ tư duy phản biện: Nghiên cứu về các triết gia" cho thấy các mô hình ngôn ngữ (LMs) thiếu cảm giác về bản thân và tính chủ động. Nghiên cứu chỉ ra rằng LMs không phải là công cụ tư duy phản biện tốt vì hai lý do chính:

LMs quá trung lập, tách biệt và không đánh giá.

LMs quá phục tùng, bị động và thiếu tò mò.

Tuy nhiên, LMs có thể đóng vai trò như nguồn cảm hứng cho ý tưởng, tương tự như khi một người bị bí ý tưởng viết truyện có thể dùng LMs để gợi mở đề tài sáng tạo. Ví dụ:

Người dùng nhập lệnh: "Đề xuất ý tưởng cho một truyện khoa học viễn tưởng có yếu tố du hành thời gian và AI"

LM phản hồi: "Một nhà khoa học phát hiện ra một vòng lặp thời gian nơi AI kiểm soát quá khứ, hiện tại và tương lai, nhưng một trục trặc có thể xóa sạch toàn bộ lịch sử loài người."

Ý tưởng này đóng vai trò như chất xúc tác, khơi gợi trí tưởng tượng của tác giả để phát triển một cốt truyện độc đáo.

Các mô hình LMs cũng có thể hỗ trợ trong việc hoàn thiện ý tưởng. Ví dụ, một sinh viên đang viết bản nháp bài luận về biến đổi khí hậu:

Sinh viên nhập lệnh: "Hãy phản hồi cho bài luận về biến đổi khí hậu của tôi"

LM phản hồi: "Lập luận của bạn khá mạnh mẽ, nhưng hãy xem xét mở rộng phần về các giải pháp năng lượng tái tạo và bổ sung dữ liệu hỗ trợ cho luận điểm của bạn."

Nhờ đó, sinh viên có thể phát triển một bài viết có sức thuyết phục hơn và dựa trên bằng chứng rõ ràng hơn. Đây là nơi các mô hình ngôn ngữ hữu ích: cung cấp ý tưởng khởi đầu (kích thích) và hỗ trợ hoàn thiện (tinh chỉnh). Nhưng còn những khía cạnh như chất vấn, định hướng lại, phân tích và xây dựng ý tưởng — những phần cốt lõi của tư duy phản biện — thì sao?

Một số thách thức trong quá trình xây dựng mô hình cần được giải quyết trước khi có thể tích hợp đầy đủ khả năng tư duy phản biện vào các LLM. Điều này có thể đòi hỏi phải suy nghĩ lại về cách tinh chỉnh và điều chỉnh mô hình. LLMs cần hiểu rõ những gì đang diễn ra trong cuộc đối thoại, bao gồm cả những gì chưa được nói ra.

Cho đến khi những thách thức đó được giải quyết, chúng ta nên tiếp tục suy nghĩ cách làm việc với AI và tránh rơi vào “tình trạng béo phì AI” (AI Obesity). Như Pascal Bornet đã viết trong cuốn sách của mình:

Chúng ta không nên để AI đảm nhận mọi nhiệm vụ sáng tạo.

Đừng phụ thuộc vào AI trong việc ra quyết định hay giải quyết vấn đề — điều này làm suy yếu tư duy phản biện của chúng ta.

Nhiều tổ chức, đặc biệt là các trường đại học, đang cùng nhau phát triển các nguồn tài nguyên nhằm giúp sinh viên củng cố kỹ năng tư duy phản biện trong thời đại AI. Một ví dụ là Đại học Newcastle, nơi đã xây dựng một danh sách kiểm tra gồm 6 câu hỏi nhằm khuyến khích tư duy phản biện.

Khi bạn lựa chọn sử dụng công cụ AI tại nơi làm việc hoặc trong đời sống cá nhân, hãy tạm dừng trước khi chấp nhận phản hồi của chúng. Hãy suy ngẫm những điểm sau:

AI vẫn chưa thể hiểu được những sắc thái và tinh tế của ngôn ngữ và ngữ cảnh con người.

“Kiến thức” mà các công cụ AI tạo ra hiếm khi phản ánh dữ liệu sau một thời điểm nhất định, nên chúng thường không biết nhiều về các sự kiện hoặc nguồn thông tin gần đây.

AI phản hồi theo những lệnh nhập (prompt) mà chúng ta soạn. Để tạo ra lời nhắc tốt không chỉ cần hiểu cách công cụ hoạt động và nội dung cần tìm mà còn cần có tư duy phản biện.

AI tạo ra giải pháp dựa trên nhận dạng mẫu và cửa sổ ngữ cảnh được xác định trước.

Các giá trị điều hướng quyết định của chúng ta và la bàn đạo đức của con người không tồn tại trong hệ thống AI, dẫn đến các kết quả thường rất “vừa đủ dùng” và thiếu chiều sâu.

Dù có thể được huấn luyện lại bằng dữ liệu mới, AI vẫn thiếu khả năng lý luận kiểu con người (tức là cập nhật chiến lược khi có thông tin mới hoặc trong hoàn cảnh thay đổi).

Các công cụ AI thường không công bố nguồn dữ liệu của chúng, cũng không tuyên bố được huấn luyện trên tập dữ liệu cụ thể nào. Điều đó có nghĩa là chúng ta không biết ai là người tạo ra thông tin gốc mà AI sử dụng và cũng không biết họ có đủ kỹ năng, kinh nghiệm hay chuyên môn hay không.

Bản thân AI nó không tốt cũng không xấu. Tuy nhiên, nếu được sử dụng đúng cách, AI có thể nâng cao năng suất của chúng ta và khiến chúng ta trở nên giá trị hơn trong công việc và cuộc sống.

Đừng chấp nhận những câu trả lời “tạm ổn”, hãy suy nghĩ phản biện và tránh rơi vào tình trạng béo phì AI.

----------

Tác giả: Andrea Rosales

Link bài gốc: AI Obesity: Are We Losing Our Critical Thinking Skills?

Dịch giả: Lê Ngọc Khánh - ToMo - Learn Something New

Không có nhận xét nào: